La Rivoluzione della Partnership Uomo-AI nella Sicurezza Alimentare Europea

La trasformazione digitale che sta investendo l'Autorità Europea per la Sicurezza Alimentare (EFSA) rappresenta una rivoluzione paradigmatica nell'approccio alla valutazione del rischio alimentare. Attraverso l'implementazione strategica di tecnologie di intelligenza artificiale human-centric, EFSA sta ridefinendo gli standard globali per la scienza regolatoria, stabilendo un nuovo modello di collaborazione tra expertise umana e capacità computazionali avanzate che promette di trasformare non solo il panorama europeo, ma l'intero ecosistema globale della sicurezza alimentare.

Alessandro Drago

Automazione vs Augmentazione: due paradigmi a confronto

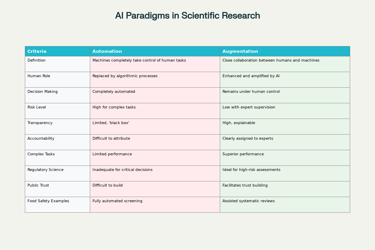

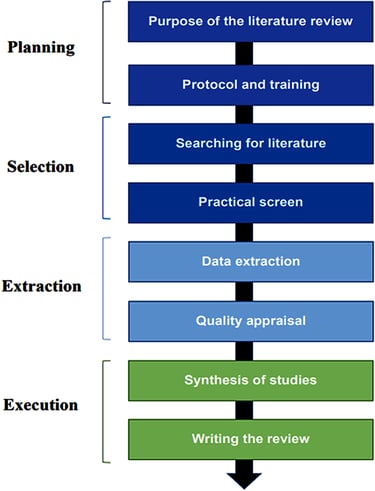

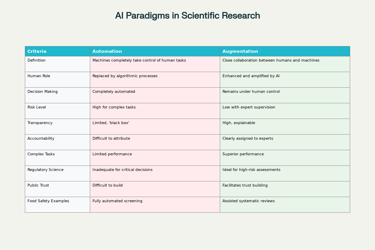

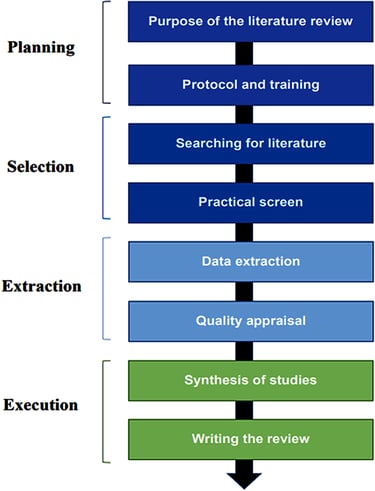

Prima di analizzare l'approccio rivoluzionario di EFSA, è fondamentale comprendere la distinzione teorica e pratica tra automation e augmentation nel contesto dell'intelligenza artificiale applicata ai processi scientifici e regolatori. Questa distinzione non è meramente accademica, ma rappresenta una scelta strategica che determina l'impatto dell'AI sull'organizzazione, sui lavoratori e sulla società nel suo complesso.

Definizioni e caratteristiche fondamentali

L'automation implica che le macchine assumano completamente il controllo di un task umano, sostituendo l'intervento umano con processi algoritmici. In questo paradigma, l'obiettivo è eliminare la necessità di supervisione umana, creando sistemi autonomi capaci di eseguire compiti senza intervento esterno. L'automation si concentra tipicamente su attività ben strutturate, con input chiaramente definiti e output predicibili.

L'augmentation, al contrario, significa che gli esseri umani collaborano strettamente con le macchine per svolgere un compito. In questo modello, l'AI non sostituisce il giudizio umano ma lo potenzia, espandendo le capacità cognitive e permettendo agli esperti di processare volumi di informazione precedentemente inaccessibili. L'augmentation mantiene l'essere umano al centro del processo decisionale, utilizzando l'AI come strumento di supporto e amplificazione delle competenze esistenti.

La ricerca empirica di Raisch e Krakowski (2021) ha identificato il "paradosso automation-augmentation", dimostrando che nel dominio manageriale queste due applicazioni AI sono interdipendenti attraverso tempo e spazio, creando una tensione paradossale che richiede approcci sofisticati di gestione. Sottolineare eccessivamente l'automation o l'augmentation alimenta cicli di rinforzo con outcome organizzativi e sociali negativi, mentre l'adozione di una prospettiva più ampia che comprende entrambi gli approcci può generare complementarità benefiche per business e società.

Applicazioni nel Contesto Scientifico-Regolatorio

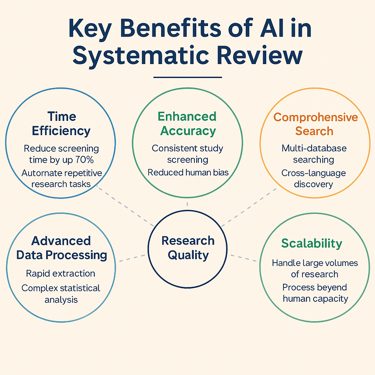

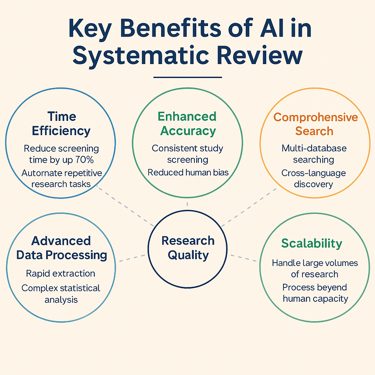

Nel contesto specifico della scienza regolatoria, la distinzione assume connotazioni critiche. L'automation in systematic reviews può includere l'identificazione completamente automatizzata di studi rilevanti, l'estrazione automatica di dati senza supervisione umana e la generazione automatica di sintesi. Mentre questo approccio può offrire significative riduzioni di tempo e costi, presenta rischi sostanziali in termini di accuratezza e affidabilità, particolarmente problematici in contesti ad alto rischio come la sicurezza alimentare.

L'augmentation nelle revisioni sistematiche, invece, utilizza l'AI per assistere ricercatori umani in compiti specifici mantenendo la supervisione esperta. Questo include screening assistito dove l'AI prioritizza documenti ma gli esperti mantengono il controllo decisionale finale, estrazione di dati semi-automatizzata con validazione umana, e analisi cognitive che identificano pattern per supportare interpretazioni esperte.

Uno studio recente su applicazioni AI in reumatologia ha dimostrato che l'approccio augmentation può ridurre i tempi di screening dell'83% mantenendo l'identificazione del 95% degli articoli rilevanti, evidenziando come la collaborazione human-AI superi sia approcci completamente manuali che completamente automatizzati.

Implicazioni per la fiducia e responsabilità

La scelta tra automazione e augmentazione ha profonde implicazioni per la fiducia pubblica e la responsabilità scientifica. Come evidenziato da Vaccaro et al. (2024), i sistemi che combinano intelligenza umana e strumenti AI possono affrontare questioni di importanza sociale ma presentano sfide specifiche. La ricerca ha identificato che l'augmentation umana esiste quando i gruppi human-AI performano meglio degli umani che lavorano da soli, mentre la sinergia human-AI richiede che performino meglio sia degli umani che dell'AI operanti singolarmente.

Nel contesto regolatorio, l'augmentation offre vantaggi critici in termini di transparency e explainability. Quando gli esperti umani mantengono il controllo decisionale finale, possono fornire giustificazioni per le decisioni prese, identificare limitazioni dei sistemi AI e intervenire quando necessario. Questo è particolarmente importante in domini ad alto rischio dove le decisioni hanno conseguenze dirette sulla salute pubblica.

Evidenze empiriche e performance comparativa

La letteratura scientifica fornisce evidenze crescenti sulla superiorità dell'approccio augmentation in contesti knowledge-intensive. Marguerit (2025) ha analizzato gli effetti dell'AI sul mercato del lavoro USA dal 2015 al 2022, distinguendo tra automation AI e augmentation AI. I risultati supportano l'ipotesi che le tecnologie automation AI siano più applicabili a occupazioni low-skilled, mentre l'augmentation AI è più efficace per ruoli high-skilled che richiedono creatività, giudizio critico e competenze interpersonali.

Nel healthcare, un'analisi comparativa tra data scientists e clinici ha rivelato che entrambi i gruppi preferiscono livelli 2 e 3 di human-AI teaming (dove l'AI augmenta la performance umana o gli umani augmentano la performance AI) per 4 su 6 compiti core in unità di terapia intensiva. Solo per il monitoring è stato preferito il livello 4 (AI che performa senza input umano), evidenziando come anche in contesti altamente tecnologici la collaborazione rimanga preferibile all'automation completa.

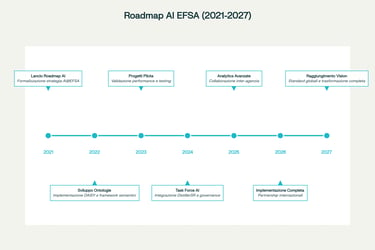

Il framework strategico: dalla visione all'implementazione

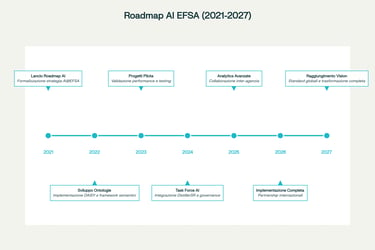

L'iniziativa AI@EFSA, formalizzata nella roadmap del 2022, non rappresenta semplicemente un aggiornamento tecnologico, ma una trasformazione strutturale che mira a raggiungere entro il 2027 tre obiettivi fondamentali: incrementare l'accessibilità del corpus di evidenze scientifiche, ampliarne l'ampiezza e potenziare l'affidabilità del processo di valutazione del rischio. Questa visione è supportata da un framework architetturale robusto che poggia su quattro pilastri tecnologici critici: governance dell'AI affidabile, ontologie sofisticate per l'organizzazione dei dati, infrastruttura per big data e capacità complete di Machine Learning Operations (MLOps).

Il modello implementativo adottato da EFSA si distingue per il suo approccio human-centric, dove l'intelligenza artificiale non sostituisce il giudizio scientifico umano, ma lo potenzia attraverso processi di augmentation piuttosto che di automazione completa. Questo paradigma, definito come "human-augmented approach", mantiene la responsabilità decisionale finale presso gli esperti scientifici, garantendo al contempo un'efficienza operativa significativamente incrementata.

La task force AI istituita nel gennaio 2024 ha operato su tre dimensioni strategiche: sviluppo di una rete interna di esperti interessati, identificazione degli investimenti IT necessari per l'adozione dell'AI e supporto alla definizione di linee guida interne conformi alle raccomandazioni di organismi di controllo e audit dell'UE. Entro la fine del 2024, la task force ha raggiunto il consenso su un insieme di principi guida e definizioni preliminari per l'approccio AI di EFSA, fornendo una bussola per orientare i processi decisionali futuri.

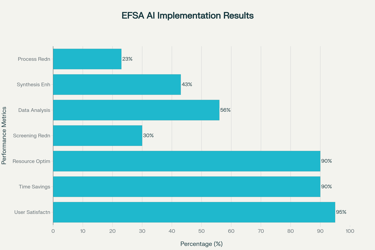

Performance quantitative: i risultati della trasformazione

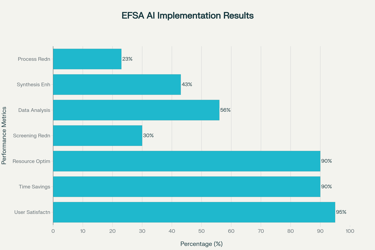

I dati empirici raccolti dall'implementazione pilota delle tecnologie AI in EFSA documentano risultati straordinari in termini di efficacia e accettazione da parte della comunità scientifica. L'analisi di 41 partecipanti che utilizzano revisioni sistematiche assistite da AI ha rivelato tassi di soddisfazione eccezionali: 21 utenti completamente soddisfatti e 14 parzialmente soddisfatti, corrispondenti a un tasso di soddisfazione del 95%.

I guadagni di efficienza si manifestano attraverso metriche quantitative precise: il 90% degli utilizzatori ha sperimentato significativi risparmi di tempo, mentre il 90% ha registrato ottimizzazioni nell'allocazione delle risorse umane. La validazione indipendente condotta dal Behavioural Insights Team del governo britannico ha confermato che le revisioni sistematiche assistite da AI vengono completate con una riduzione del 23% dei tempi rispetto agli approcci tradizionali.

L'analisi granulare del processo di revisione sistematica rivela dove l'AI genera il massimo impatto: riduzione del 30% del tempo nelle fasi di screening, miglioramento del 56% nell'analisi dei dati e potenziamento del 43% nelle fasi di sintesi. Queste metriche rappresentano guadagni trasformativi che liberano i ricercatori per attività scientifiche ad alto valore aggiunto, consentendo loro di concentrarsi sul pensiero critico, l'interpretazione contestualizzata e l'elaborazione di giudizi complessi che richiedono vera comprensione delle implicazioni scientifiche e sociali.

La performance di EFSA nel 2024 ha registrato una produzione scientifica di 550 questions, con miglioramenti significativi nell'indice di tempestività dell'adozione rispetto al 2023, nonostante la maggiore complessità scientifica e procedurale del lavoro dell'Autorità. Questo risultato testimonia l'efficacia dell'approccio AI-assistito nel gestire volumi crescenti di lavoro scientifico mantenendo standard qualitativi elevati.

DAISY e DistillerSR: eccellenza tecnologica in azione

Il cuore dell'implementazione AI di EFSA è rappresentato dal sistema DistillerSR, potenziato dalla piattaforma DAISY (DistillerSR Artificial Intelligence System). Questa soluzione tecnologica integrata gestisce sistematicamente le fasi più labor-intensive delle revisioni sistematiche, includendo identificazione di parole chiave, deduplicazione, prioritizzazione dei riferimenti, screening di titoli e abstract, classificazione automatica e verifica degli errori di screening.

Le performance del sistema DAISY sono documentate attraverso metriche rigorose: l'AI raggiunge una sensibilità media del 90% nello screening degli abstract, con precision, recall e F1-score che oscillano tra l'80% e il 100% nei compiti di estrazione dati. Nel contesto specializzato della valutazione del rischio, dove l'omissione di un singolo studio rilevante può influenzare decisioni critiche per la sicurezza pubblica, queste metriche di performance rappresentano la differenza tra buona scienza e eccellenza scientifica.

L'implementazione pilota di DAISY attraverso cinque casi d'uso specifici ha dimostrato l'efficacia dell'approccio modulare: dalla valutazione dell'usabilità degli strumenti di summarizzazione automatica per le consultazioni pubbliche, all'automazione dell'identificazione delle parole chiave nei processi di revisione sistematica, fino alla creazione di manuali personalizzati per facilitare lo screening di rilevanza assistito da AI. Questa diversificazione applicativa evidenzia la versatilità e l'adattabilità del framework tecnologico sviluppato.

La governance del rischio: validazione e responsabilità scientifica

L'approccio di EFSA all'implementazione dell'AI si distingue per la sofisticata comprensione delle attuali capacità e limitazioni tecnologiche. La strategia di implementazione si concentra su compiti ad alto volume e basso giudizio soggettivo, dove l'AI eccelle: normalizzazione terminologica, rimozione di duplicati, screening di rilevanza e clustering della letteratura.

Il framework di governance implementato garantisce che ogni applicazione AI sia sottoposta a validazione rigorosa contro gold standard e supervisione esperta continua. Questa architettura di controllo assicura che l'AI serva come strumento di potenziamento piuttosto che di sostituzione, mantenendo la responsabilità scientifica finale sempre presso gli esperti umani. La Standard Operating Procedure (SOP) 048 "Govern Technology and Transformation" fornisce il quadro metodologico per gestire i processi IT secondo le migliori pratiche di mercato, stabilendo politiche e procedure che garantiscono l'allineamento strategico tra business e tecnologia.

La Web Application for Distiller Model Control, sviluppata specificamente per EFSA, rappresenta un ulteriore livello di garanzia qualitativa, fornendo moduli per la generazione di campioni casuali di riferimenti per l'addestramento degli strumenti AI e per la valutazione delle performance su set di validazione. Questo sistema di controllo continuo assicura che la qualità scientifica rimanga il parametro guida di tutte le implementazioni AI.

Ontologie e knowledge networks: l'architettura della conoscenza

L'implementazione AI di EFSA poggia su un'architettura ontologica sofisticata che rappresenta uno dei pilastri fondamentali della trasformazione digitale. La survey condotta su 40 ontologie e 7 sistemi di organizzazione della conoscenza relativi alla sicurezza alimentare ha fornito le basi per lo sviluppo di un framework semantico integrato. Questo lavoro sistematico ha identificato le ontologie più rilevanti per il dominio della sicurezza alimentare, categorizzandole secondo criteri di rilevanza, copertura, coerenza semantica e riusabilità.

Il progetto FSO (Food Safety Ontology) sviluppato nell'ambito del programma DiTECT illustra l'approccio metodologico adottato: massima riutilizzazione di ontologie esistenti e ampiamente utilizzate, come AGROVOC per il dominio agricolo, CHEBI per i composti chimici e SOSA per sensori e osservazioni. Questa strategia di integrazione semantica permette l'interoperabilità tra diversi domini scientifici, facilitando l'analisi trasversale di dati eterogenei.

L'architettura ontologica supporta funzionalità avanzate come il knowledge mining e scenari "Chat with your documents" che stanno rivoluzionando il modo in cui gli scienziati interagiscono con la letteratura di ricerca. Queste applicazioni cognitive permettono di scoprire pattern e relazioni in milioni di testi che richiederebbero decenni di lavoro manuale per essere identificate e digerite dai ricercatori umani.

Cognitive analytics e machine learning: verso l'intelligenza aumentata

La roadmap strategica di EFSA incorpora cognitive analytics avanzate, inclusi machine learning e natural language processing, per scoprire pattern e relazioni in informazioni provenienti da milioni di testi, libri, articoli online e altre fonti, inclusi social media. Questa capacità di analisi cognitiva rappresenta un salto qualitativo nell'elaborazione dell'evidenza scientifica, permettendo di processare volumi di informazione che superano di ordini di grandezza le capacità umane tradizionali.

Il progetto AI4NAMs (Artificial Intelligence for New Approach Methodologies) ha sistematicamente esplorato il potenziale dell'applicazione di metodi AI alla raccolta e integrazione di dati NAMs, supportando una migliore valutazione del rischio chimico e riducendo contemporaneamente la sperimentazione animale. I risultati hanno dimostrato che l'AI può supportare efficacemente l'intero workflow di gestione dei dati NAMs, dalla ricerca e estrazione all'armonizzazione e integrazione in reti simili agli Adverse Outcome Pathways (AOP).

La fine-tuning di Large Language Models per la sicurezza alimentare e mangimistica rappresenta una frontiera particolarmente promettente. L'adattamento di modelli linguistici pre-addestrati alle specificità del dominio food safety permette di sviluppare assistenti conversazionali specializzati capaci di supportare gli esperti nell'analisi e interpretazione di documenti tecnici complessi.[36]

Collaborazioni internazionali e partnership strategiche

Il modello collaborativo di EFSA si estende attraverso una rete sofisticata di partnership internazionali e inter-agenzia. La Cross-agency One Health Task Force, stabilita da cinque agenzie EU (ECDC, ECHA, EEA, EFSA ed EMA), ha rilasciato il Framework for Action per operazionalizzare l'approccio One Health attraverso coordinamento, promozione della ricerca, rafforzamento delle capacità, comunicazione e attività congiunte.

Il framework di collaborazione prevede l'introduzione dell'AI nelle agenzie europee attraverso collaborazione e condivisione reciproca con organismi UE e internazionali. Questa visione inter-agenzia mira a stabilire una roadmap AI europea comune, identificando e implementando casi d'uso di interesse condiviso e creando una struttura di governance comune per le applicazioni AI tra le agenzie europee.

Il progetto FoodSafety4EU rappresenta un esempio concreto di questa collaborazione multi-stakeholder, sviluppando una piattaforma che collega attori del sistema di sicurezza alimentare per facilitare l'accesso, la condivisione e lo scambio di conoscenze scientifiche, risorse e dati. La piattaforma supporta un approccio multi-attore partecipativo che sperimentalizza e abilita un approccio proattivo e di co-creazione per la trasformazione del sistema di sicurezza alimentare.

Metodologia agile e digital transformation

L'adozione della metodologia Agile rappresenta un cambio di paradigma nell'approccio EFSA alla trasformazione digitale. L'introduzione di metodologie agili per miglioramenti più rapidi e maggiore focus sul cliente è supportata da un framework di governance che bilancia flessibilità operativa e controllo strategico. I progetti che implementano il programma di lavoro 2027 affrontano il change management e lo sviluppo di competenze digitali necessarie per sfruttare gli strumenti del nuovo secolo.

La metodologia Semi-Agile descritta nelle procedure operative standard di EFSA fornisce un framework strutturato per la gestione di progetti di trasformazione tecnologica. Questo approccio permette di rispondere rapidamente ai cambiamenti dei requisiti mantenendo la tracciabilità e il controllo qualità necessari in un ambiente regolatorio.

Il potenziamento delle capacità di business analytics e lo sviluppo di dashboard interattive supportano un processo decisionale data-driven a tutti i livelli organizzativi. Questi strumenti permettono di monitorare in tempo reale le performance dei processi AI-assistiti e di identificare rapidamente aree di miglioramento o potenziali criticità.

Sicurezza cibernetica e data management

La strategia di digitalizzazione di EFSA riconosce la sicurezza cibernetica come elemento critico per il successo dell'implementazione AI. Il rafforzamento della cybersecurity attraverso tutte le operazioni EFSA è identificato come priorità strategica nella mid-term review della Strategy 2027. La crescente interconnettività dei sistemi AI richiede protocolli di sicurezza sofisticati per proteggere l'integrità dei dati e prevenire attacchi che potrebbero compromettere l'affidabilità delle valutazioni scientifiche.

L'implementazione di framework FAIR (Findable, Accessible, Interoperable, Reusable) per la gestione dei dati garantisce che i dataset utilizzati per l'addestramento e la validazione dei modelli AI siano di alta qualità e privi di bias sistematici. La metodologia di mappatura dei flussi di dati sviluppata da EFSA fornisce una comprensione completa dei percorsi informativi a livello nazionale, identificando sfide esistenti e soluzioni comuni implementabili.

Il Data Protection Impact Assessment (DPIA) viene applicato sistematicamente prima dell'introduzione di nuove tecnologie critiche per il trattamento dei dati personali, assicurando la compliance con il GDPR e mantenendo la fiducia pubblica nell'uso responsabile dell'AI.

Case studies e applicazioni settoriali

L'implementazione dell'AI in EFSA si manifesta attraverso case studies specifici che dimostrano l'applicabilità pratica delle tecnologie sviluppate. Il monitoraggio AI-driven delle informazioni front-of-package sui prodotti alimentari rappresenta un esempio di come l'intelligenza artificiale possa automatizzare processi tradizionalmente labor-intensive. L'applicazione di tecniche di computer vision e natural language processing al riconoscimento di marchi di certificazione e informazioni nutrizionali su alimenti per l'infanzia ha dimostrato l'efficacia dell'approccio automatizzato nella raccolta di dati di mercato.

La predizione della compliance per la sicurezza alimentare attraverso approcci di machine learning illustra come l'AI possa supportare ispezioni più mirate ed efficaci. L'utilizzo della synthetic minority oversampling technique insieme ad algoritmi random forest ha raggiunto prestazioni di rilevamento dell'84% per outlet non-conformi, dimostrando il potenziale dell'AI nel migliorare l'efficienza dei controlli ufficiali.

Il progetto di trasformazione della produttività agricola attraverso previsioni AI-driven evidenzia l'applicabilità dell'intelligenza artificiale lungo l'intera catena alimentare. L'integrazione di AI tools nel processing alimentare, incluse tecnologie plasma, ozone e Pulsed Electric Field, mostra come l'innovazione tecnologica possa simultaneamente migliorare la sicurezza e l'efficienza produttiva.

Prospettive future: la visione 2027 e oltre

La roadmap strategica di EFSA si estende verso scenari tecnologici avanzati che rivoluzioneranno l'interazione tra scienziati e letteratura di ricerca. Gli sviluppi pianificati includono funzionalità "Chat with your documents" che permetteranno interrogazioni conversazionali del corpus scientifico, analytics cognitive per la scoperta di pattern in milioni di testi e automazione di revisioni sistematiche che richiederebbero decenni di lavoro manuale.

Il framework di collaborazione internazionale prevede l'estensione delle partnership ad agenzie come ECHA, EMA e altri organismi EU, con la creazione di reti modello "Academy" per capacity building e scambio di conoscenze. Questa visione collaborativa potrebbe trasformare la scienza regolatoria non solo in Europa, ma stabilire standard globali per l'integrazione responsabile dell'AI nella ricerca scientifica.

L'integrazione con il EU common data platform on chemicals rappresenta una sfida e un'opportunità strategica per EFSA. La collaborazione con DG Health and Food Safety, altre agenzie EU e il Joint Research Centre nella strutturazione e automazione della sottomissione, validazione e valutazione di dossier regolatori richiederà investimenti significativi in AI e data science expertise.

Challenges e mitigazione dei rischi

L'implementazione dell'AI in EFSA non è priva di sfide significative. La necessità di bilanciare innovazione tecnologica con considerazioni etiche richiede un approccio prudente e metodico. Le questioni relative alla proprietà dei dati, le richieste di confidenzialità da parte dei richiedenti e la necessità di trasparenza verso gli Stati Membri rappresentano tensioni che devono essere gestite attraverso framework di governance sofisticati.

La qualità e disponibilità dei dati rappresentano prerequisiti fondamentali per il successo delle applicazioni AI. Molte autorità di sicurezza alimentare, specialmente nei paesi a medio e basso reddito, affrontano scarsità di dati e vincoli di capacità che limitano l'adozione di tecnologie AI avanzate. Il rafforzamento della AI e data management literacy, particolarmente nel settore pubblico, sarà chiave per sbloccare i benefici di queste tecnologie.

La vulnerabilità delle imprese alimentari a prodotti e applicazioni AI non rigorosamente testati o validati rappresenta un rischio sistemico emergente. La FSA britannica ha identificato la necessità di meccanismi di validazione indipendenti e standard per assicurare che i sistemi AI utilizzati nella sicurezza alimentare siano sicuri, affidabili e fit for purpose.

Training e capacity building

Lo sviluppo di competenze AI rappresenta un investimento strategico critico per il successo della trasformazione EFSA. La formazione continua e l'upskilling del personale attuale sono essenziali, specialmente negli anni a venire. Entro la fine del 2027, EFSA mira ad aver stabilito le capacità fondamentali necessarie per integrare responsabilmente l'AI nell'organizzazione, includendo non solo gli strumenti tecnici ma anche i framework di governance e controllo.

L'approccio di open innovation suggerito per EFSA involve lo scambio strategico di conoscenze, integrando insights esterni e condividendo idee centrali per accelerare l'innovazione interna. Le collaborazioni con stakeholder accademici, industriali e altre autorità competenti che hanno già sviluppato strategie o servizi utili per i processi interni di EFSA rappresentano opportunità di learning accelerato.

La creazione di repository e documentazione degli strumenti AI applicati, insieme al confronto e valutazione delle tecniche utilizzate, fornisce una base di conoscenza condivisa che supporta la standardizzazione delle migliori pratiche.

Impatto globale e sostenibilità del modello

Il modello EFSA sta già influenzando l'approccio alla sicurezza alimentare a livello internazionale. La FAO ha riconosciuto il potenziale trasformativo dell'AI nella gestione della sicurezza alimentare, con il documento "Artificial intelligence (AI) for food safety – A literature synthesis, real-world applications and regulatory frameworks" che documenta l'adozione di approcci simili da parte di autorità nazionali globali.

La pubblicazione FAO evidenzia applicazioni reali dell'AI attraverso test di laboratorio, ispezioni e sorveglianza, prioritizzazione del controllo alle frontiere, efficienza regolatoria e comunicazione del rischio, fornendo la prima panoramica globale dell'implementazione AI nel settore food safety. Le case studies includono esempi emergenti da paesi a medio e basso reddito, dimostrando la scalabilità e adattabilità del framework concettuale sviluppato da EFSA.

La sostenibilità del modello EFSA è garantita dalla sua architettura scalabile e dalla crescente collaborazione con istituzioni accademiche e agenzie internazionali. I progetti FoodSafety4EU e HOLiFOOD stanno già pilotando approcci co-sviluppati per l'identificazione AI-driven dei rischi emergenti, dimostrando la replicabilità e l'adattabilità del framework EFSA. L'investimento in AI literacy è identificato come elemento essenziale per permettere scelte informate sull'uso responsabile degli strumenti AI nella sicurezza alimentare.

Considerazioni Etiche e Responsabilità Sociale

L'approccio human-centric di EFSA all'implementazione AI riflette una profonda consapevolezza delle implicazioni etiche e sociali delle tecnologie emergenti. La partnership strategica tra intelligenza umana e artificiale non mira alla sostituzione dell'expertise scientifica, ma alla sua amplificazione attraverso strumenti che permettono di processare volumi di informazione precedentemente inaccessibili.

La responsabilità scientifica finale rimane sempre presso gli esperti umani, garantendo che il giudizio critico, l'interpretazione contestuale e la comprensione delle implicazioni sociali rimangano al centro del processo decisionale. Questo principio fondamentale distingue l'approccio EFSA da implementazioni AI puramente automatizzate, mantenendo la dimensione umana essenziale per la fiducia pubblica nella scienza regolatoria.

La trasparenza e l'accountability rappresentano pilastri dell'implementazione AI in EFSA. Ogni applicazione è documentata, validata e sottoposta a supervisione continua, creando un sistema di controlli e bilanciamenti che protegge l'integrità scientifica mentre sfrutta le potenzialità tecnologiche avanzate.

La trasformazione in corso a Bruxelles rappresenta più di un'evoluzione tecnologica: è la dimostrazione che quando l'intelligenza artificiale viene implementata con rigore scientifico, governance appropriata e validazione continua, può migliorare drammaticamente l'efficienza scientifica senza compromettere l'integrità che la fiducia pubblica richiede. Il modello EFSA stabilisce un nuovo paradigma per la scienza regolatoria del XXI secolo, dove l'expertise umana e le capacità computazionali avanzate operano in sinergia per proteggere la salute pubblica con precisione ed efficienza senza precedenti.

Questo approccio visionario non solo trasforma il modo in cui EFSA conduce le sue valutazioni scientifiche, ma crea un template replicabile per autorità regolatorie in tutto il mondo, dimostrando che l'innovazione tecnologica e l'eccellenza scientifica possono coesistere e potenziarsi reciprocamente nell'interesse supremo della sicurezza alimentare globale

#TrasformazioneAI #SicurezzaAlimentare #RegolazioneUE #InnovazioneScientifica #ScienzaRegolatoria #AIHumanCentric #EFSA #SaluteDigitale #PoliticheEvidenceBased #TecnologiaRegolamentare #AIinScienza #RegulatoryTech #RegolazioneIntelligente #InvazioneScientifica

Disclaimer: Tutti i diritti delle immagini e contenuti utilizzati appartengono ai rispettivi proprietari.

--------------------------------------------------------------------------

1. https://journals.aom.org/doi/10.5465/amr.2018.0072

4. https://www.aalpha.net/blog/human-ai-collaboration-augmenting-capabilities-with-agentic-platforms/

6. https://link.springer.com/10.1007/s00607-023-01181-x

8. https://pmc.ncbi.nlm.nih.gov/articles/PMC11826052/

9. https://pmc.ncbi.nlm.nih.gov/articles/PMC6582554/

10. https://pmc.ncbi.nlm.nih.gov/articles/PMC11624811/

11. https://www.nature.com/articles/s41562-024-02024-1

12. https://www.tandfonline.com/doi/pdf/10.1080/13600834.2021.1958860?needAccess=true

13. https://arxiv.org/pdf/2503.19159.pdf

14. https://www.jmir.org/2024/1/e50130

15. https://www.efsa.europa.eu/en/corporate-pubs/aiefsa

16. https://www.efsa.europa.eu/en/supporting/pub/en-7339

20. https://www.efsa.europa.eu/sites/default/files/2024-03/4-update-on-advisory-group-data.pdf

22. https://www.efsa.europa.eu/en/supporting/pub/en-8223

23. https://bmjopen.bmj.com/lookup/doi/10.1136/bmjopen-2023-072254

24. https://pmc.ncbi.nlm.nih.gov/articles/PMC10335470/

25. https://www.efsa.europa.eu/sites/default/files/event/mb100/Item 04 - doc1 - AAR2024 - mb250327-a2.pdf

26. https://www.distillersr.com/products/distillersr-systematic-review-software

27. https://www.distillersr.com/resources/updates/whats-new-in-distillersr-makeover-time

28. https://pmc.ncbi.nlm.nih.gov/articles/PMC7559198/

30. https://www.efsa.europa.eu/en/supporting/pub/en-9394

31. http://users.ics.forth.gr/~tzitzik/publications/Tzitzikas-2024-EFSA-Ontologies.pdf

32. https://ceur-ws.org/Vol-3415/paper-5.pdf

34. https://www.efsa.europa.eu/sites/default/files/2022-01/amp2325.pdf

35. https://www.efsa.europa.eu/sites/default/files/event/mb93/mb221215-a3.pdf

37. https://www.efsa.europa.eu/en/supporting/pub/en-8567

38. https://pmc.ncbi.nlm.nih.gov/articles/PMC11584592/

39. https://www.efsa.europa.eu/sites/default/files/event/2020/AF200401-p3.4_CH_MH.pdf

40. https://foodsafetyplatform.eu

41. https://pmc.ncbi.nlm.nih.gov/articles/PMC9749438/

42. https://euagenda.eu/publications/download/637218

43. https://science-council.food.gov.uk/Results and Discussion

44. https://www.efsa.europa.eu/en/supporting/pub/en-9654

45. https://dx.plos.org/10.1371/journal.pone.0303083

46. https://www.mdpi.com/1660-4601/18/23/12635/pdf

47. https://www.mdpi.com/2571-9394/6/4/46

48. https://www.efsa.europa.eu/sites/default/files/EFSA_Environmental_Scan_Report_2019.pdf

49. https://www.fao.org/food-safety/news/news-details/en/c/1748997/

50. https://international-animalhealth.com/wp-content/uploads/2024/10/FEED-AND-ADDITIVES.pdf

51. https://www.fao.org/food-safety/news/news-details/ru/c/1743810/

53. https://www.nature.com/articles/s41598-024-59616-0

54. https://www.semanticscholar.org/paper/be0cd07d1d590b7dc7475cd3bb9d01dbf1862db6

55. https://aja.journals.ekb.eg/article_452225.html

56. https://onlinelibrary.wiley.com/doi/10.1002/hfm.70022

57. https://al-kindipublishers.org/index.php/jcsts/article/view/8592

58. https://ieeexplore.ieee.org/document/10653012/

59. https://www.jippublication.com/index.php/jip/article/view/162

60. https://account.theoryandpractice.citizenscienceassociation.org/index.php/up-j-cstp/article/view/738

61. https://ijsrem.com/download/ai-driven-accounting-opportunities-challenges-and-the-road-ahead/

62. https://dx.plos.org/10.1371/journal.pone.0298037

63. https://onlinelibrary.wiley.com/doi/pdfdirect/10.1111/rego.12568

64. https://pmc.ncbi.nlm.nih.gov/articles/PMC11066064/

65. https://arxiv.org/pdf/2402.08466.pdf

66. http://arxiv.org/pdf/2503.02250.pdf

67. https://arxiv.org/html/2410.14353

68. http://arxiv.org/pdf/2403.00148.pdf

69. https://intuitionlabs.ai/articles/ai-future-regulatory-affairs-pharma

70. https://researchswinger.org/publications/aijobs25.pdf

71. https://pubsonline.informs.org/doi/10.1287/mnsc.2024.05684

72. https://www.sciencedirect.com/science/article/pii/S2452414X25000950

73. https://www.mdpi.com/1996-1944/17/21/5285

74. https://journals.sagepub.com/doi/10.1177/23259671221149403

75. https://revistes.ub.edu/index.php/der/article/view/41399

76. https://academic.oup.com/jamia/article/32/6/1071/8126534

77. https://link.springer.com/10.1007/s00217-024-04553-5

78. https://link.springer.com/10.1007/s42979-023-02583-6

79. https://josr-online.biomedcentral.com/articles/10.1186/s13018-024-05234-5

80. https://afju.springeropen.com/articles/10.1186/s12301-024-00464-9

81. https://www.mdpi.com/2305-6290/7/4/80

82. https://arxiv.org/ftp/arxiv/papers/2403/2403.08352.pdf

83. https://zenodo.org/record/8338404/files/RaischKrakowski_AMR_inpress.pdf

84. https://pmc.ncbi.nlm.nih.gov/articles/PMC4100748/

85. https://www.annualreviews.org/content/journals/10.1146/annurev-soc-090523-050708

Contatti

Seguimi su LinkedIn

Nutri-AI 2025 - Alessandro Drago. Tutti i diritti sono riservati

e-mail: info@nutri-ai.net